GPT-4o: nouvelle fonctionnalité audio révolutionnaire – À découvrir!

OpenAI annonce de nouvelles fonctionnalités pour les API audio

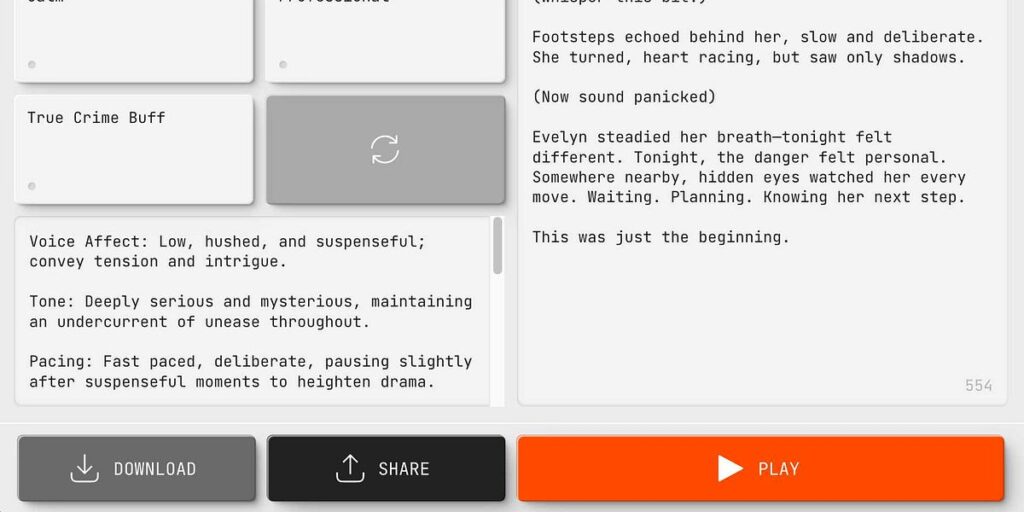

OpenAI a annoncé aujourd’hui plusieurs nouvelles fonctionnalités audio pour ses API de text-to-speech et de speech-to-text. Parmi celles-ci, le modèle de text-to-speech gpt-4o-mini-tts est sorti avec une interface de jeu passionnante disponible sur OpenAI.fm. Cette interface permet de choisir parmi 11 voix de base et d’appliquer des instructions telles que “High-energy, eccentric, and slightly unhinged” pour lire un script. Ces modèles permettent également de générer du code API équivalent en Python, JavaScript ou curl. Il est possible de partager les expérimentations réalisées avec ces nouveaux modèles.

Les risques liés à l’instruction accidentelle

Cependant, l’insertion d’instructions dans le script même peut poser problème, car il est possible que certaines parties du texte soient traitées comme des instructions supplémentaires pour le modèle. Cela peut engendrer des résultats non déterministes qui varient en fonction des voix de base utilisées. OpenAI estime le coût de ces nouveaux modèles entre 0,3 et 0,6 cents par minute.

Améliorations dans les modèles de speech-to-text

Les modèles de speech-to-text gpt-4o-transcribe et gpt-4o-mini-transcribe, offrent des alternatives similaires et établissent une “nouvelle référence en termes de qualité”. Bien que ces modèles présentent des avancées, le risque d’instruction accidentelle reste une préoccupation, en particulier lors de la transcription audio.

Ayant répondu à ces problématiques, Jeff Harris d’OpenAI souligne la nécessité d’une fidélité absolue au script lors de la lecture, mais des risques subsistent.

Les défis de la transcription audio avec des modèles basés sur LLM

Ces difficultés rencontrées dans les nouveaux modèles font écho aux défis liés à l’injection d’instructions directes. Les architectures LLM peuvent présenter des vulnérabilités lorsque des parties du texte sont mal interprétées comme des instructions pour le modèle. Malgré les efforts d’amélioration et les développements récents, il reste à voir si ces modèles seront efficaces dans des applications réelles sans causer de problèmes.

Source : simonw.substack.com